Peut-on faire confiance aux algorithmes pour prendre des décisions judiciaires ?

Les algorithmes s'invitent peu à peu dans la justice pour évaluer les risques de récidive, proposer des peines ou analyser des dossiers. Mais peut-on leur faire confiance pour juger ? Cet article s'appuie sur des chiffres, des exemples concrets et l'évolution de leur adoption pour éclairer le débat.

Pourquoi certains pays testent les algorithmes en justice ?

Des outils comme COMPAS aux États-Unis sont utilisés depuis les années 2000 pour évaluer le risque de récidive. L'objectif affiché est d'accélérer le traitement des affaires, d'apporter plus de cohérence et de réduire la charge de travail des juges.

COMPAS, un exemple emblématique

L'enquête de ProPublica (2016) a montré que COMPAS classait les Afro-Américains presque deux fois plus souvent comme "à haut risque" sans récidive réelle. De plus, seuls 20 % des individus jugés à risque élevé récidivaient réellement.

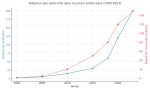

Adoption des algorithmes : une progression rapide

Depuis les années 2000, l'usage des outils prédictifs s'est largement répandu aux États-Unis. Vers 2017-2018, plus de 60 juridictions utilisaient déjà ces systèmes, couvrant environ 25 % de la population américaine. Aujourd'hui, on estime qu'environ 200 juridictions (États ou comtés) y ont recours.

Quels sont les risques concrets pour les citoyens ?

Les algorithmes sont des "boîtes noires" : leur fonctionnement est souvent opaque et protégé par le secret commercial. Dans l'affaire Loomis vs Wisconsin, un prévenu a contesté sa condamnation fondée sur COMPAS, sans pouvoir connaître le calcul exact de son score.

Une efficacité toute relative

Selon une étude de Dartmouth (Science Advances, 2018), COMPAS atteint 65 % de précision, soit un score similaire à un groupe de personnes non formées (67 %). L'algorithme n'est donc pas plus fiable qu'un jugement humain basique.

Comment encadrer ces pratiques ?

Le Conseil de l'Europe a publié en 2018 une Charte éthique sur l'usage de l'IA dans les systèmes judiciaires. Elle impose 5 principes : respect des droits fondamentaux, non-discrimination, transparence, impartialité et contrôle humain obligatoire.

Sources principales

Les algorithmes sont-ils plus justes que les juges humains ?

Pas forcément. COMPAS a montré des biais raciaux et n'est pas plus précis qu'un humain non expert.

Quels pays testent déjà des algorithmes pour rendre des décisions judiciaires ?

Les États-Unis utilisent COMPAS pour évaluer la récidive. L'Estonie et l'Espagne testent des outils pour des litiges mineurs ou la prévention des violences conjugales.

Quels risques les citoyens courent-ils si la justice s'appuie sur des algorithmes pour prendre des décisions ?

Les citoyens risquent de subir des décisions biaisées et difficiles à contester, car fondées sur des systèmes opaques protégés par le secret commercial.

Peut-on contester une décision prise sur la base d’un algorithme judiciaire ?

Oui, mais cela reste difficile lorsque l'algorithme est propriétaire et non transparent. D'où l'importance d'une obligation d'explicabilité.

Quelle place donner à l’IA dans la justice du futur ?

Les experts recommandent de limiter l'IA à un rôle d'assistant et de maintenir un contrôle humain total sur les décisions finales.